Amazonで売上を伸ばすために、日々さまざまな施策を打っている方は多いはずです。メイン画像の差し替え、A+コンテンツの更新、価格変更、クーポン配布、スポンサー広告のキャンペーン追加、セール、VINEの活用――施策の手段は年々増え続けています。しかし、「打った施策が本当に売上・KPIに効いたのか」を正しく検証できているケースは驚くほど少ないのが実情です。

施策効果を科学的に測る手段として、セラーセントラル/ベンダーセントラルには 比較テストの管理(Manage Your Experiments) が用意されています。これはAmazonがブランドオーナーに無償提供している本格的なA/Bテスト基盤で、商品ページ要素の検証においては非常に強力な武器になります。ただし、対象範囲が商品ページの一部要素に限定されているという設計思想上の特徴があり、日常運用の全施策をこれ一本で検証し切るのは構造的に難しいのも事実です。

この記事では、まず比較テストの管理の価値と得意領域を正当に評価したうえで、その対象外となる領域で必要になる Before/After検証のフレームワーク を解説します。最後に、そのBefore/After検証を自動化するUbun BASEの「施策レポート」機能をご紹介します。データ分析全体の業務フローについてはこちらの記事もあわせてご覧ください。

目次

- なぜAmazonで「施策検証」が重要なのか

- Amazon公式のABテスト機能「比較テストの管理(Manage Your Experiments)」とは

- 比較テストの管理とは(概要・サービス名の変遷)

- セラー版/ベンダー版の違い(アクセスパス・名称差異)

- 比較テストの管理で検証できる施策

- 利用資格と対象ASINの条件

- 比較テストの設定5ステップ(Amazon公式手順)

- 良い比較テストを設計する条件

- 比較テストのステータスと編集可否

- 結果の読み解き方と「予測される1年間の影響」

- 方法論の裏側(ベイズ的アプローチ)

- コンテンツ検証の主要ガイドライン

- 効果を最大化する運用ヒント

- 比較テストのアイデア20選

- よくある質問(抜粋)

- 結果画面の読み解き方

- メリット:Before/Afterでは到達できない「純粋比較」の価値

- 実務Tips・よくある失敗

- カバー範囲について:設計思想上のトレードオフ

- 比較テストの管理と「役割分担」するBefore/After比較

- Before/After検証でつまずく5つのポイント

- Before/After検証を回す5ステップ・フレームワーク

- 単発のBefore/Afterだけでは足りない――長期トレンドで評価する視点

- Ubun BASEの「施策レポート」機能でBefore/Afterを自動化する

- まとめ

なぜAmazonで「施策検証」が重要なのか

Amazonで売上を伸ばすための打ち手は、突き詰めると「商品ページ改善」「広告運用」「価格・プロモーション」「レビュー獲得」「外部誘導」などに分類されます。これらはどれも売上に寄与する可能性がある一方で、やってみなければ効果がわからないという共通点を持ちます。

特にAmazonというプラットフォームは、カタログ・検索・広告・レコメンドが密接に連動しており、単一の変数だけを変えて効果測定するのが難しい構造です。だからこそ、施策ごとに「いつ、何を、どの商品に対して実施したのか」を記録し、売上とKPIの変化を継続的に観測することが、再現性のある成長には不可欠です。

施策検証がないと起きること

- 「なんとなく効いた気がする」で終わる:主観的な評価で次の打ち手が決まるため、再現性が低い

- 属人化する:担当者の記憶・Excelファイルに施策履歴が埋もれ、引き継ぎ時に消失する

- 失敗施策を繰り返す:過去の結果が記録されていないため、同じ打ち手を何度も試してしまう

- 上司・クライアントへの説明ができない:売上が伸びた/落ちた理由を定量的に語れない

つまり施策検証とは、単なる「効果測定」ではなく、組織としての学習メカニズムそのものなのです。

Amazon公式のABテスト機能「比較テストの管理(Manage Your Experiments)」とは

施策効果を精緻に測る手段として、Amazonは 比較テストの管理(Manage Your Experiments) というABテスト機能を無償提供しています。これはAmazonがブランドオーナーに提供する極めて優秀な無料ツールであり、世界最大級のECプラットフォーム上でリアルトラフィックを用いて稼働する本物のA/Bテスト基盤です。同じ商品ページにアクセスしたユーザーに対してバージョンAとバージョンBをランダムに出し分け、どちらのほうが売上・CVRが高かったかを統計的に判定してくれる、Amazon公式の本格的なABテストプラットフォームと言えます。

改めて強調したいのは、ランダムな出し分け・指標の集計・統計的有意性の判定まで、Amazon側がすべて自動で実行してくれるという点です。本来であれば自社で同等の仕組みを用意しようとすると、ランダム化エンジン・トラフィック分割基盤・リアルタイム集計DB・統計処理ロジックといった相応の開発コストとデータ基盤が必要になります。その一式を、ブランド登録済みの出品者であれば無料で使えるのは、端的に言って破格です。

比較テストの管理とは(概要・サービス名の変遷)

比較テストの管理は、もともと英語UIで 「Manage Your Experiments(MYE)」 という名称で提供されていた機能で、日本語UIでは「比較テストの管理」として表示されます。海外のAmazon運用者コミュニティでは「MYE」と略されることも多く、同じ機能を指す呼び方と覚えておくと各種ドキュメントを横断的に読み解きやすくなります。

機能の本質は、同じASINの商品詳細ページに訪れたユーザーを、Amazon側がランダムに「バージョンA群」と「バージョンB群」に振り分けて、両群のパフォーマンス差を統計的に計測するという点にあります。運用者自身がトラフィック配分や集計期間を気にする必要はなく、Amazonがバックグラウンドで統計処理まで行ってくれるため、ABテストの前提知識がなくても利用できます。専門知識ゼロでも業界標準のA/Bテストが回せるというのは、本機能の大きな価値です。

セラー版/ベンダー版の違い(アクセスパス・名称差異)

比較テストの管理は、セラーセントラルとベンダーセントラルの両方から利用可能ですが、アクセスパスとメニュー表記に差があります。

| 区分 | メニュー位置 | 表記 |

|---|---|---|

| セラーセントラル | 「ブランド」メニュー →「比較テストの管理」/または「A/Bテスト」 | A/Bテスト/比較テストの管理 |

| ベンダーセントラル | 「Merchandising」→「Manage Your Experiments」 | Manage Your Experiments |

いずれも前提としてAmazonブランド登録(Brand Registry)が完了していることが必要で、ブランド登録が未済の出品者は本機能を利用できません。また、セラー版とベンダー版では検証可能な要素の範囲がわずかに異なる場合があるため、実際のメニューから対象商品を選択した際に表示される「検証可能な項目」を確認するのが確実です。

比較テストの管理で検証できる施策

2026年時点で、比較テストの管理が対応している検証対象は基本的に商品詳細ページ内の要素に限られます。言い換えると、商品ページ要素の磨き込みという領域においては、業界最高水準の検証環境が標準で手に入るということです。

| 対応している検証対象 | 内容 | 検証時に試したい論点例 |

|---|---|---|

| タイトル | 商品名表記のABテスト | ブランド名の位置/容量・個数の記載有無/訴求キーワード(例:「高濃度」「大容量」)/ターゲット属性(例:「女性用」) |

| メイン画像 | 1枚目画像の訴求軸を比較 | パッケージのみ/使用シーン入り/成分アイコン入り/正面・斜め構図/背景の白抜き度合い |

| 商品紹介コンテンツ(A+) | A+のバージョンを出し分けて比較 | 訴求順の入れ替え(ベネフィット先行 vs スペック先行)/比較表の有無/レビュー抜粋の掲載/動画モジュールの追加 |

| 商品説明文・箇条書き(バレットポイント) | テキスト要素の訴求比較 | ベネフィット表現の言い換え/文字数(長文 vs 短文)/冒頭キーワードの変更/数値の入れ込み |

| ブランドストーリー | ブランドストーリーモジュール内訴求の比較 | 創業ストーリー vs 製法へのこだわり/使用者インタビュー/サステナビリティ訴求 |

ただし、検証可能な要素はAmazon側の仕様変更によって拡張・制限されることがあります。実際にテストを作成する際は、セラーセントラル/ベンダーセントラルの管理画面上で「このASINに対して現在作成可能な検証対象」を確認してから設計するのが確実です。

利用資格と対象ASINの条件

比較テストの管理は、現在米国・カナダ・メキシコ・イギリス・ドイツ・フランス・スペイン・イタリア・オランダ・ポーランド・スウェーデン・インド・日本の各Amazonマーケットプレイスで利用可能です。ブランド全体の利用条件と、個別ASINの対象可否は以下のとおりです。

- ブランドの利用資格:Amazon Brand Registryに登録済みのブランド所有者として登録されていること。ブランドの内部関係者であり、Amazonストアでブランド商品の販売権限を持つ必要があります。

- 対象ASINの条件:出品者のブランドに属しており、過去数週間に比較テストの対象となる閲覧数を十分に獲得していること。Amazonは「終了時に確信をもって良い結果を獲得したコンテンツを判断できる可能性が高くなるように」と、閲覧数の多いASINに絞ってテスト実施を許可しています。

- 同時実施数:同一ASINに対して一度に実施できる比較テストは1つのみ。ただし「複数項目」テストタイプを使えば、1本のテストの中で商品名・画像・商品仕様といった複数要素を同時に試せます。

- A+/ブランドストーリーの前提条件:A+コンテンツ・ブランドストーリーの比較テストを行うには、対象ASINで既にA+コンテンツ/ブランドストーリーが公開済みであることが必要です。

対象ASINにならない場合の対処は意外とシンプルで、「閲覧数を増やす」こと――つまり広告投下や外部誘導などでトラフィックを稼ぐことで、後日対象入りする可能性があります。自社カタログの中で主力ASIN群から優先的にテスト計画を立てるのが現実解になります。

比較テストの設定5ステップ(Amazon公式手順)

Amazon公式ドキュメントに沿った比較テストの作成手順は、大きく5ステップで構成されます。

- ステップ1:比較テストを開始する

比較テストの管理のメイン画面で「新規の比較テストの作成」ドロップダウンをクリックし、テストタイプを選択します。選べるのは 商品紹介(Aプラス)コンテンツ/商品仕様/商品画像/商品説明/商品名/Aプラスのブランドストーリー/複数項目 の7種類です。 - ステップ2:対象となるASIN(参照ASIN)を選択する

「参照ASIN」とは、比較テストで使用される主な商品のことです。

・A+/ブランドストーリーでは、既存の承認済みコンテンツから選択するか、A+管理画面で新規作成も可能(同じページの「バージョンAを複製して開始します」から移動できます)。

・複数項目テストでは、1本のテスト内で商品名・画像・商品仕様などを同時にA/Bテストできます。

・推奨情報:機械学習に基づいた改善案がAmazon側から提示されることがあります(過去の何千もの比較テストの分析結果に基づくコンテンツ別分析)。

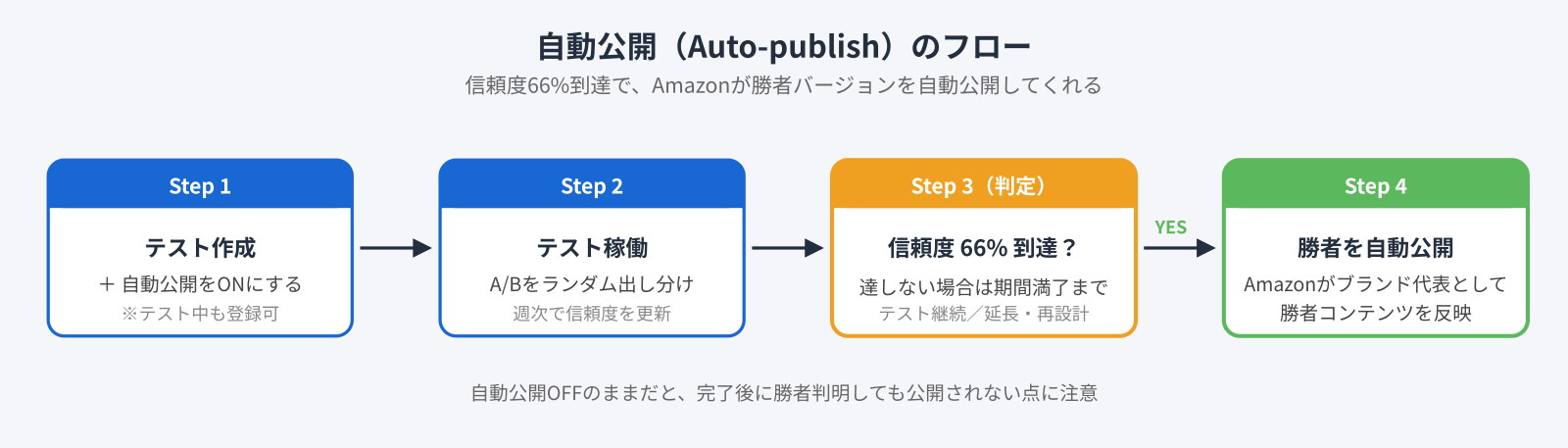

・自動公開(Auto-publish):テスト作成時またはテスト中に登録可能。有効にすると、良い結果のバージョンの信頼度が66%以上になった時点でAmazonがブランド代表者に代わって勝者コンテンツを公開します。

・バリエーションASIN:親ASINを参照ASINにすると、含められる子ASINと対象可否が一覧表示されます。一部の子ASINが閲覧数不足で対象外になることもあります。 - ステップ3:比較テストの詳細を入力する

・比較テスト名:出品者にのみ表示される識別用の名称。

・仮説:最も重要な要素。「商品名を曖昧なものから明確なものに変更すると、売り上げが伸びるのではないか」といった形で、期待する評価内容を言語化しておきます。仮説を明文化することで、この商品以外にも学びを適用できるようになります。

・期間と開始日:推奨は8〜10週間。固定期間を選ばない場合は「有意性」モードを選択でき、統計的に関連性のある結果が出た時点でAmazonが自動でテストを終了します(ベータ機能。商品名と画像のテストで利用可能)。自動公開×有意性を組み合わせると、最短4週間以内に統計的妥当性に到達した時点で良い結果を獲得したコンテンツが自動的に公開されます。

・開始日注意:コンテンツタイプによっては、Amazon側の検証時間のため最短開始日が数日先になる場合があります。 - ステップ4:比較テストを行うコンテンツを選択する

テストタイプに応じて入力内容が変わります。

・商品名/商品仕様/商品説明:それぞれのフィールドに比較テスト用のテキストを入力。

・商品画像:「画像をアップロード」から対象画像を選択。

・A+コンテンツ:バージョンAは既存の承認済みコンテンツから選択。バージョンBは新規作成/バージョンAの複製編集/既存のバリエーションから選択、のいずれかから作成可能。

・ブランドストーリー:A+同様の扱いで、既存の承認済みブランドストーリーから選ぶか、新規作成・複製編集・バリエーション選択が可能。

・複数項目:対象項目を選んで、それぞれにバージョンA/Bを作成。

・バリエーションASIN:子ASINの商品名・商品画像を一部送信できますが、常に親商品のコンテンツを送信する必要があります。

・下書き保存:テスト設定は最長2週間、下書きとして保存できます。 - ステップ5:比較テストを送信する

送信時点でテストは「スケジュール済み(コンテンツの検証待ち)」ステータスになります。数日後に管理画面で検証結果を確認し、失敗していた場合(例:白背景カテゴリーに白以外の画像を送ってしまった)は指摘内容に沿ってコンテンツを修正し、再送信します。

また、セラーセントラルの在庫ページで商品名を直接更新すると、新しい商品名が自動的にバージョンBとなる形で商品名テストが作成されるという「簡単設定」もあります。これはダッシュボード上で比較テストソース「登録一覧ページ」と表示され、そのまま登録・解除が可能です。母の日・バレンタインなどの商戦期キーワードをすぐに反映したい場合は登録解除しておくと安全です。

良い比較テストを設計する条件

Amazon公式の推奨事項をベースに、有意な結果が出やすいテスト設計のポイントを整理します。

- バージョンAとBを「大きく」変える:A+ならモジュール自体やモジュールの順序を変える、商品名なら長さを大幅短縮する、画像なら訴求軸の違う構図を試す、ブランドストーリーなら背景画像やモジュール構成を変える。差異が大きいほど「偶然の結果ではない有意な差」として検出されやすくなります。

- 期間は8〜10週間を基準に:可能な限り多くのデータを集めるため。短縮するより長めに設計する方が結果の信頼度が上がります。

- 期間に迷うなら「有意性」モード:商品名・画像のテストでは、統計的な関連性に到達した時点でAmazonが自動終了してくれるため、期間設計の悩みから解放されます。

- 自動公開を積極的に活用:66%以上の信頼度で勝者を自動公開してくれるため、「テストは走ったが公開忘れ」を防げます。

- A+/ブランドストーリーは同一ASINセットに紐付け:A+管理画面上で、バージョンA・Bの両方が同一のASINセットに適用されていないとテストを設定できません。

- 複数要素を同時に試したいときは「複数項目」テスト:商品名変更+画像ロゴ追加+A+変更を1本のテストで検証可能。

比較テストのステータスと編集可否

比較テストには複数のステータスがあり、ステータスによって編集できる範囲が変わります。

| ステータス | 意味 | 編集可否 |

|---|---|---|

| スケジュール済み(検証待ち) | Amazonがコンテンツを検証中 | コンテンツを含む全詳細を編集可 |

| コンテンツの検証に失敗 | ガイドライン違反等で不合格 | 修正して再送信が必要 |

| スケジュール済み(検証合格) | テスト開始待ち | スケジュールはロック。内容変更すると再検証のため開始日を再設定 |

| 比較テスト中 | テスト実行中 | コンテンツ変更不可。仮説と期間のみ編集可。中身を変えたい場合はキャンセルして新規作成 |

| キャンセル済み | 途中で打ち切り | 編集不可。収集済み結果はダッシュボードで引き続き確認可能 |

| 完了 | 期間満了 | 編集不可。結果にかかわらず、勝者は自動公開されない点に注意(自動公開登録している場合を除く) |

とりわけ実務で忘れやすいのが「完了後は自動公開されない」という点です。自動公開を有効にしていない場合、テスト終了後に勝者コンテンツを別途公開する作業が必要になります。A+・ブランドストーリーはA+管理画面から、商品名・画像などは商品登録/アップロードから、標準の出品ツールで反映してください。

結果の読み解き方と「予測される1年間の影響」

比較テストの結果は週に1回更新され、ダッシュボードの比較テスト名をクリックして詳細にアクセスできます。Amazonが提供する結果の主な要素は次のとおりです。

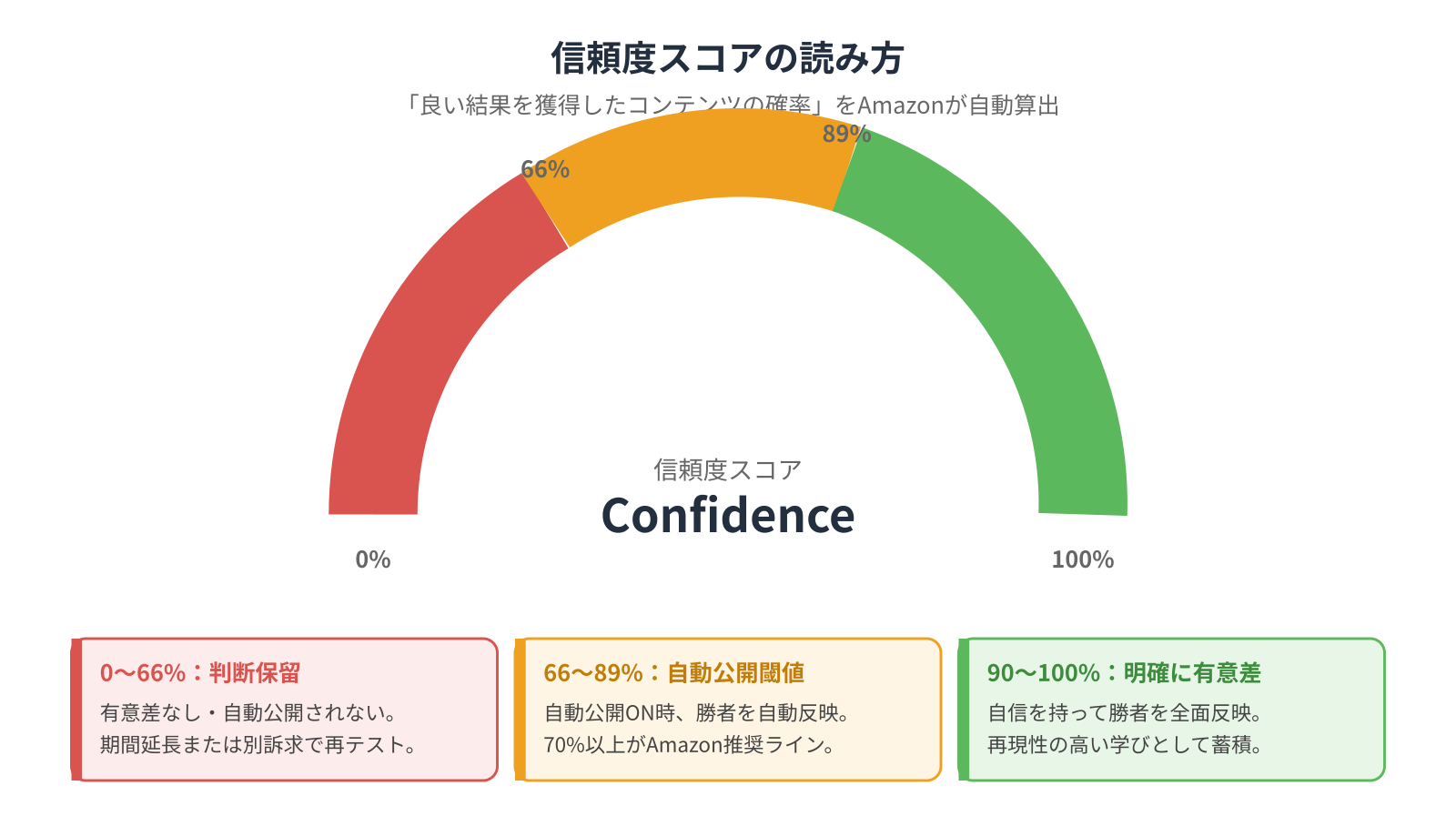

- 良い結果を獲得したコンテンツの確率:例えば「バージョンAのほうが優れている確率が75%」と表示される。これは「バージョンAを公開することで売上向上効果が発生する可能性が75%」という意味。

- コンテンツ別の指標:商品数、売り上げ、コンバージョン率、個別訪問者ごとの販売数、サンプル数の5指標をバージョンA/Bで比較可能。サンプル数は該当バージョンを閲覧した個別訪問者の数、個別訪問者ごとの販売数は商品数÷サンプル数で算出されます。

- 予測される1年間の影響:完了テストでのみ表示される指標で、勝者バージョンを公開した場合の向こう1年間の商品数と売上増分の見込みを提示してくれる機能。高信頼度の結果ではほぼプラスになり、低信頼度の結果では最悪ケースでマイナスになることもあり得ます(テスト中にパフォーマンスが悪かったコンテンツも時間経過で改善する可能性があるため)。季節性・価格変動・その他ビジネス要因は考慮されないため情報提供目的の参考値として扱うのが適切です。

- 95%信頼区間:予測影響には「良いケース」「可能性が高い(中央値=50パーセンタイル)」「悪いケース」の3点が表示され、これは95%信頼区間に基づく値です。

また、比較テストの結果が決定的でない(Inconclusive)になることもありますが、それでも十分に価値ある学びになります。

- コンテンツの変更量が少なく、購入者行動に変化を与えなかった

- 高信頼度の判断ができるだけの閲覧数が集まらなかった

- 2バージョンの販促効果が類似していた

- 変更内容が購入判断上の関心ポイントではなかった

いずれのケースも、仮説と照らし合わせて「この要素は動かしても効かない」「この訴求軸では差が出ない」というネガティブな学びとして蓄積できます。次回以降の仮説設計に活かしましょう。

方法論の裏側(ベイズ的アプローチ)

比較テストの裏側でAmazonが採用しているのはベイズ的アプローチです。テスト中は、モデルと実際の結果に基づいて確率分布を構築し、平均効果量(商品数ベース)と事後確率分布の95%信頼区間を毎週更新しながらレポートします。

- 比較テストは個別の購入者アカウント単位で振り分け。購入者は一方のバージョンにランダム割当され、デバイス種類等に関係なく永続的に同じバージョンを閲覧します。

- 購入者を特定できないページアクセスはサンプル数に含まれません。

- 統計的外れ値など、精度を下げるデータは自動除外されます。

- 「良い結果を獲得したコンテンツの信頼度」は、販売数の影響がプラスであることを示す確率分布の割合として計算されます。

- 1年間の影響予測は、比較テスト期間中の1日当たり売上の平均差×365日で算出され、95%信頼区間が付与されます。

コンテンツ検証の主要ガイドライン

比較テスト用に送信するコンテンツは、通常の出品コンテンツと同じガイドラインを満たす必要があります。特に抑えておきたい主要ルールは以下です。

- 商品名:スペースを含めて200文字以下(カテゴリーによってはさらに短い制限あり)。

- 商品画像:鮮明・情報密度・魅力度の3要素が重要。カテゴリーごとに背景色などの要件あり。

- A+コンテンツ:バージョンAは既に承認済みである必要あり。バージョンBはテスト設定時に送信できますが、開始前までに両バージョンとも承認されている必要があります。

- ブランドストーリー:A+と同じく、バージョンAは承認済みである必要あり。

- 商品仕様:商品ごとに5項目まで、合計1,000文字未満が推奨。

- 商品説明:カテゴリーごとに文字数制限あり。競合への言及は禁止。

効果を最大化する運用ヒント

実務で比較テストの効果を最大限引き出すためのヒントをまとめます。

- 既存と差が大きいコンテンツを用意する:差が小さいと購入者行動に影響せず、信頼度が上がらない。

- 期間を最後まで走らせる:初期結果で早期終了すると、効果を過大評価したり誤った勝者を選んだりするリスクが高い。

- 有意性モードで期間設計の悩みを手放す:最適な期間がわからないときは、統計到達時に自動終了してくれる有意性モードが安全。

- 自動公開で反映漏れを防ぐ:66%以上の信頼度で自動公開。テストしたのに公開忘れで売上機会を逃すのを防げる。

- A+・ブランドストーリーは同一ASINセット:A+管理画面上で両バージョンが同一ASINに適用されているか必ず確認。

- 複数要素は「複数項目」テストで:商品名にブランド名追加+画像ロゴ追加+A+改修、などを1本で検証可能。

- 中間結果を見に行きすぎない:中間結果は誤解を招くだけでなく、精神的にもテストの早期終了を誘発する。

- テストを継続する:1本で終わらせず、別ASIN・別仮説・季節違いでも実施することで、自社ブランド全体のコンテンツ戦略が磨かれていく。

比較テストのアイデア20選

「何をテストすればよいかわからない」という声も多いので、Amazon公式の推奨例+実務でよく効くアイデアを列挙します。あくまで出発点として、自社商品に合わせてアレンジしてください。

- 商品名の長さを100文字未満に抑える(不要情報の削ぎ落とし)

- 商品名にブランド名を追加する

- 商品名を曖昧→明確に書き換える(具体的な便益・数値を入れる)

- 商品名冒頭のキーワード順序を入れ替える

- 商品名にターゲット属性(例:「女性用」「敏感肌向け」)を追加

- メイン画像にクリエイティブな訴求を追加して競合より目立たせる

- 画像を高解像度版に差し替える/既存画像を更新

- ライフスタイル画像 vs 定番商品画像を比較

- 商品画像の訴求要素(成分アイコン・容量・認証マーク)を追加

- 特徴を対比で強調(Before/After、対競合比較等)

- A+に新しいモジュール(比較表/動画/レビュー抜粋)を取り入れる

- A+に比較表モジュールを使って自社複数商品を整理

- A+の訴求順序(ベネフィット先行 vs スペック先行)を入れ替える

- ブランドストーリーで背景画像・モジュールを変更

- ブランドストーリーで創業ストーリー vs 製法訴求を比較

- 商品仕様(バレットポイント)を短文化して可読性を上げる

- 商品仕様の冒頭キーワードを入れ替える

- 商品説明をフレンドリートーン vs スペック訴求で比較

- Amazon推奨情報(機械学習ベースのサジェスト)をそのまま採用してテスト

- 季節・イベントに合わせた期間限定訴求の効果検証

よくある質問(抜粋)

比較テストの管理を運用していてよくぶつかる疑問を、Amazon公式FAQをベースに整理します。

- テストしたいASINが候補に出てこない:閲覧数が不足している可能性大。広告やSNS誘導などでトラフィックを増やしてから再挑戦を。

- バージョンBドロップダウンにコンテンツが表示されない:(1) コンテンツのステータスが「下書き」のままではないか確認。(2) 送信して承認済みになっているか確認。(3) バージョンBコンテンツが参照ASINに適用されているか確認。

- 「バージョンA/Bで適用ASINが異なる」と表示される:A+管理画面で、不一致ASINをコピーし、足りないバージョン側にASINを追加する。両バージョンで同一ASINセットに揃えるのが必須。

- テスト作成時に「商品名や画像を更新して」と警告が出る:AとBが類似しすぎていて有意差が出にくいというAmazonからのアラート。送信自体は可能だが、変更量を増やすことを推奨。

- 結果がまだ表示されない:結果は週次/隔週で算出。処理遅延で更新タイミングがずれることもあり、処理完了次第自動表示されます。

- 初期に良い結果が出ているのに続ける意味は?:初期結果は偶然の可能性が高く、ここで終了すると例外的な結果を根拠に意思決定してしまう。期間満了まで待つのが鉄則。

- コンテンツ検証に失敗した場合:エラーコードに沿って修正し、再送信。例:白背景必須カテゴリーに白以外の画像を送るなど。

- 有意性と固定期間、どちらを選ぶ?:最適期間が読めないときは有意性モード推奨。ASINの閲覧数次第で結論までの日数は変わります。

- 作っていないテストがダッシュボードに出ている:在庫ページで商品名を直接更新した際に自動作成される商品名テストの可能性大(「登録一覧ページ」ソース)。登録解除もボタン一つで可能。

結果画面の読み解き方

結果画面は大きく3つのブロックで構成されています。それぞれの読み解き方を押さえておくと、テスト結果を勝ち負けの判断だけで終わらせず、次の改善仮説につなげられます。

(1) サマリー(信頼度スコア)

画面上部に「X%の確率でバージョンBのほうが良い結果です」という一文が表示されます。これは統計的信頼度(いわゆる「勝ちの確からしさ」)であり、一般的な判定目安は以下のとおりです。

- 70%未満:有意差なし。勝敗判定は保留し、別の訴求で再テストするか、テスト期間を延長する。

- 70〜89%:有意差の可能性あり。Amazon公式も70%以上を勝者採用の推奨ラインとしているため、ここから勝者確定を検討してよい水準。

- 90%以上:明確に有意差あり。勝者バージョンを自信を持って全面反映してよい。

(2) 指標比較テーブル(バージョンA vs バージョンB)

一意の閲覧者数・コンバージョン数・販売数量・売上などがバージョンごとに並列表示されます。ここで注意すべきは、「売上は勝ったがCVRは負けた」のような指標間の矛盾が起きうる点です。例えばバージョンBで単価の高い派生SKUが売れやすくなり、売上は増えたが購入率自体は下がった、というケースです。どの指標を勝者判定の主指標にするかは、テスト設計時に決めておく必要があります。

(3) 週次パフォーマンスグラフ

期間内のA群とB群の指標推移を線グラフで確認できます。ここで見るべきは、「勝敗が途中で逆転していないか」「終盤でも差が維持されているか」の2点です。初週だけ大きく差がつき、以降フラットに戻っているような場合は、novelty effect(目新しさ効果)の可能性があり、長期採用に値する差とは言い切れません。

メリット:Before/Afterでは到達できない「純粋比較」の価値

比較テストの管理の最大の強みは、同時期・同トラフィック・同ユーザー属性条件下での純粋比較が可能になる点です。これはBefore/After比較では原理的に到達できない領域です。Before/Afterでは「後半にセールが入った」「前半に競合がセールしていた」「季節要因が重なった」といった外部要因が必ず結果に混入しますが、比較テストの管理はユーザー単位でランダムに出し分けるため、これらの影響が構造的にキャンセルされるのです。

さらに特筆すべきは以下の点です。

- 統計的有意性を自動算出:Amazon側が信頼度スコアまで計算してくれるため、「主観」「経験則」「エイヤ判断」から脱却し、データに基づく意思決定ができる

- 勝者バージョンのワンクリック反映:テストで得た学びを、同じ画面からそのまま本番公開バージョンに昇格できる。検証→反映のリードタイムがほぼゼロ

- 運用者の作業は「設計」と「判断」だけ:データ取得・集計・統計処理はAmazonが全て担うため、担当者は本来集中すべき仮説立案と勝者選定に集中できる

- 無料で使える:これだけの基盤が、ブランド登録済みの出品者であれば追加費用なしで利用可能

ブランド登録済みで販売実績のあるブランドにとって、比較テストの管理は端的に言って「使わない理由がない」レベルの武器です。商品ページ要素の磨き込みを主戦場とする運用者にとって、これを使いこなしているかどうかは、そのまま競争優位に直結します。

実務Tips・よくある失敗

これだけ強力な機能だからこそ、使い方を誤ると本来得られるはずの学びを取りこぼしてしまいます。現場で特によく起きる失敗と、その回避策を整理します。

- 1回に1要素だけをテストする:画像とタイトルを同時に変えたバージョンBを作ってしまうと、どちらが効いたのか切り分けられません。複数要素を試したい場合は、順番に別々のテストとして走らせます。

- 十分なトラフィックを確保してから開始する:月間数十件規模の販売しかないASINでテストしても、信頼度は60%前後で停滞しがちです。テスト前の直近4週間で数百件以上の注文規模があることを目安にします。

- セール・大型キャンペーン期間は避ける:プライムデー・ブラックフライデー等の期間はユーザー層の質が通常時と異なり、テスト結果の一般化が難しくなります。通常営業期間に実施するのが基本です。

- 中途半端な段階でテストを停止しない:1〜2週間で差がついたからといって早期終了すると、novelty effectやノイズを勝敗と誤認するリスクがあります。Amazonの推奨期間(4〜10週間)を守りましょう。

- 勝者バージョンを必ず全面反映する:意外と多いのが、テストで勝者が判明したのに「運用が落ち着いたら反映しよう」と放置し、そのままテスト前のバージョンが残り続けるパターンです。勝者確定後は即座に公開バージョンを更新し、テストで得た学びを実売に反映します。

- 負けたテストも記録に残す:「バージョンBで売上が下がった」という結果自体、次の仮説設計に役立つ貴重な資産です。勝ちテストだけを残して負けテストを忘れると、同じ失敗仮説を何度も検証してしまいます。

カバー範囲について:設計思想上のトレードオフ

ここまで見てきたように、比較テストの管理は商品ページ要素の磨き込みという領域では他に代わるものがない強力なツールです。一方で、この機能がカバーする範囲は商品ページ要素に限定されており、日常運用で発生する他の施策タイプは対象外になります。これは機能の不足というより、A/Bテストという手法の性質上、避けられないトレードオフとして理解しておくのが正確です。

整理すると、比較テストの管理は以下のような前提のもとで真価を発揮します。

- ブランド登録済みであること:Amazonブランド登録(Brand Registry)完了が前提条件です。ブランドオーナーに最適化された機能という位置づけです。

- 対象ASINに十分なトラフィック・販売実績があること:Amazon側の推奨は「月間数百件以上の注文規模」です。これはA/Bテストが統計的検出力(statistical power)を確保するために一定のサンプルサイズを必要とする、統計学上の原理的な要請です。販売規模が小さいASINや新商品には、別の検証アプローチが必要になります。

- 4〜10週間の検証期間をかけられること:統計的パワー確保のための必然です。短期で結果を出したい施策(短期セール対応や、季節立ち上がりに合わせた即時のクリエイティブ変更など)には、別の手段を組み合わせるのが効果的です。

- 検証したい論点を順番に磨き込めること:同一ASINで並行して複数テストは走らせられないため、主力SKUほど「どの論点を優先検証するか」の設計が重要になります。裏を返せば、設計がしっかりしていれば年間を通じて体系的に商品ページを磨き込めるということです。

- 検証対象が商品ページ要素であること:広告・プロモーション・価格変更・クーポン・VINE・外部誘導・ストア構成・在庫戦略などのページ外施策は、そもそもA/Bテストになじまない領域です。これらは別の検証アプローチ(後述のBefore/After)でカバーするのが合理的です。

つまり比較テストの管理は、「使える場面では積極的に使うべき、極めて強力なツール」です。商品ページ要素の検証というその得意領域においては、ブランドオーナーにとって事実上の標準装備と言ってよい武器になります。そのうえで、運用全体をカバーするには「比較テストの管理の対象外となる領域をどう検証するか」という補完の設計が必要になる――これが実務上のリアルです。

比較テストの管理と「役割分担」するBefore/After比較

ここまで見てきたとおり、比較テストの管理は商品ページ要素の磨き込みにおいては他に代えがたい強力な検証基盤です。使える施策は全力で使いこなすべき――これは間違いありません。一方で、実際のAmazon運用では、週単位・月単位で以下のような施策が次々と走ります。

- 新しいスポンサー広告キャンペーンを追加した

- クーポンを発行した/プロモーションを組んだ

- 価格を改定した

- DSP・OTT広告で認知施策を打った

- インフルエンサー経由で外部誘導した

- VINEで初期レビューを積んだ

- ストアページを刷新した

これらは比較テストの管理の設計思想上、対象外となる領域です。加えて、比較テストの管理が使える商品ページ要素の変更であっても、新商品・販売実績の少ないASIN・短期間で結果を出したいケースでは、統計的パワーの観点からA/Bテストを走らせられません。これらの領域は、比較テストの管理とは別の検証アプローチ――すなわちBefore/After比較でカバーするのが実務的に最も合理的です。

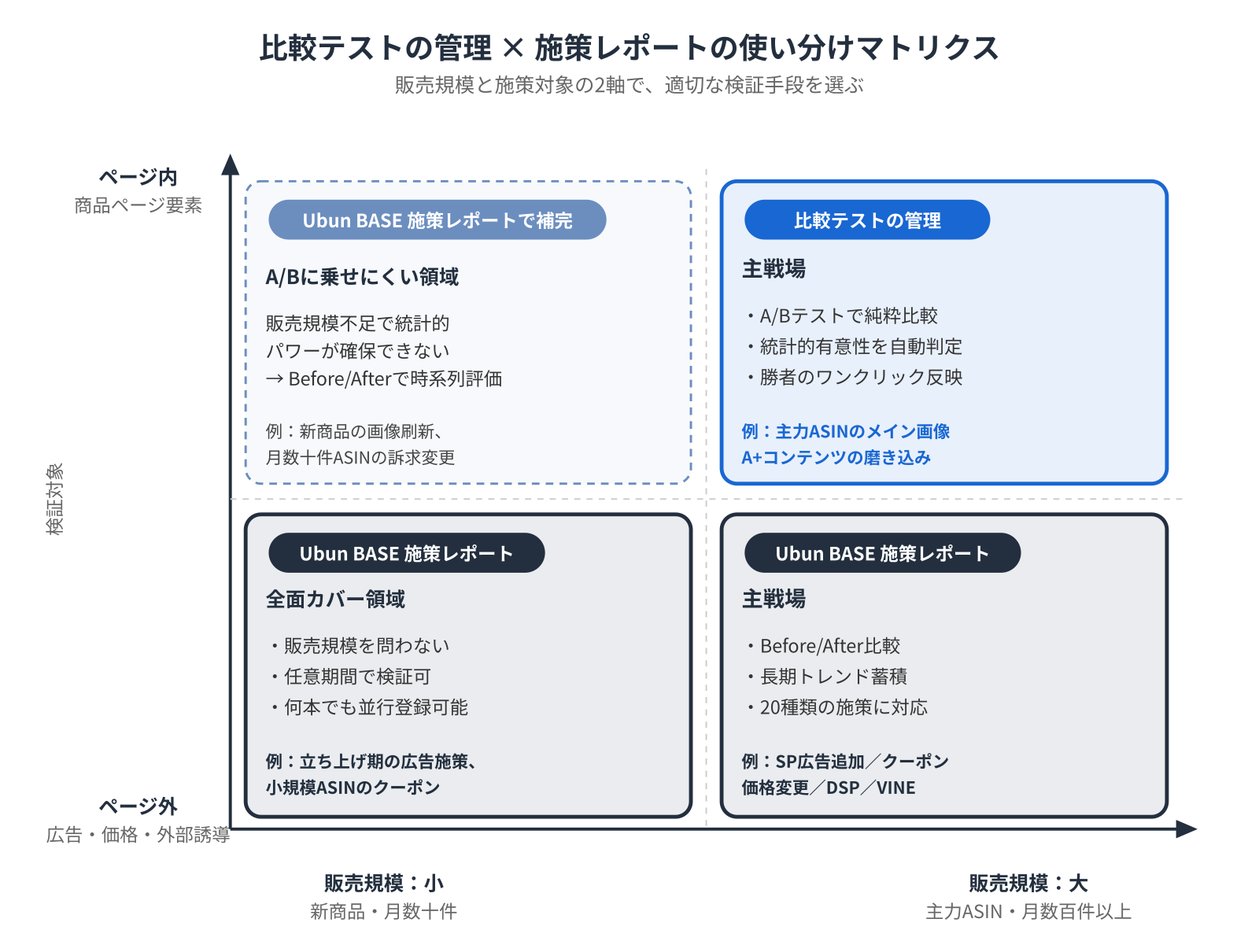

重要なのは、比較テストの管理とBefore/Afterが敵対関係ではなく、役割分担の関係にあるという認識です。比較テストの管理は「商品ページ要素を純粋な同時比較で磨き込む」ことに特化した武器、Before/Afterは「ページ外の広範な施策と、A/Bテストに乗せられない条件下の施策を時系列で評価する」ための武器。両者を適材適所で組み合わせることで、Amazon運用の全施策領域がはじめて検証可能になるのです。

したがって検証フレームとしての順序は、(1) 比較テストの管理が使える施策は必ず比較テストの管理で検証する、(2) それ以外の広範な施策はBefore/Afterで体系的に検証する――この組み合わせです。以降は、この(2)にあたるBefore/After検証を実務で回すための具体フレームを解説していきます。

Before/After検証でつまずく5つのポイント

ただしBefore/After検証も、雑に回すとすぐに形骸化します。多くの現場が共通でぶつかる壁を5つ整理します。

1. Before/Afterの期間設定が曖昧

施策反映日の前後で売上を比較したい、という発想自体は自然です。しかし「Before何日分・After何日分にするか」を事前に決めていないと、数字を見てから都合のよい期間を切り出すチェリーピッキングが起きがちです。また、Before期間にセールが入っていた場合、施策とは無関係な売上変動で比較結果が歪みます。

2. 外部要因・季節性を切り分けられない

Amazonの売上は、プライムデー・ブラックフライデー・年末商戦などのプラットフォーム全体の需要変動に大きく左右されます。「メイン画像を変えた翌週に売上が1.5倍になった」場合、その伸びがプライムデーの効果なのか画像変更の効果なのかを切り分けなければ、純粋な施策効果は測れません。

3. ハロー効果・広告外要因の混入

広告施策では、特定のスポンサー広告キャンペーンを追加したことで、広告経由売上だけでなく自然流入売上も押し上げられるハロー効果が発生します。さらに、新規レビューが増えたタイミングと広告施策のタイミングが重なると、どちらが売上に効いたのかの判別が難しくなります。

4. KPIの定義が施策ごとにバラバラ

商品ページ改善なら「注文率(CVR)」、広告施策なら「ROAS」、価格変更なら「平均売価」、というように、施策カテゴリーごとに見るべきKPIは異なります。このKPIの事前設計がないまま施策を打つと、検証段階で「結局何を見ればいいんだっけ?」となり、振り返りが曖昧になります。

5. ビジネスレポート・広告レポートを横断して見られない

Before/After検証では、セラーセントラルのビジネスレポート(売上・セッション・ユニットセッション率)と、広告コンソールの広告レポート(ROAS・広告経由売上・CVR)、さらにクーポン実績・プロモーション実績など、複数のデータソースを横断して見る必要があります。しかし、これらは管理画面も出力フォーマットもバラバラで、期間を揃えて1つのビューで比較することが難しいのが実情です。多くの出品者は「データは取れるが、突き合わせに時間がかかりすぎて検証まで手が回らない」という状態にあります。

Before/After検証を回す5ステップ・フレームワーク

これらのつまずきを避けて検証を回すには、Before/Afterを5つのステップで体系化します。

ステップ1:施策の事前設計

施策を打つ前に、以下の4点を必ず定義します。

- 施策カテゴリー:メイン画像変更/A+更新/クーポン/価格変更/スポンサー広告追加など

- 対象ASIN:全商品か、特定のASIN群か

- 施策反映日:施策を実際に実行した日

- 仮説:「この施策により、○○のKPIが△△%向上するはず」という定量仮説

事前仮説を書き留めておくことで、検証結果に対する解釈のブレを抑えられます。

ステップ2:Before/After期間の事前定義

施策反映日を基準に、Before期間とAfter期間をあらかじめ決めておきます。例えば「施策反映日の前28日間をBefore、後28日間をAfter」という具合です。期間を事前に固定することで、結果を見てから都合のよい期間に調整することを防げます。

そして、このステップ2で最も重要なのが、「Before/After期間の中に、検証したい施策以外の外部要素が入り込まないように期間を選び取る」という視点です。Amazonは365日のうち常にどこかでセールや大型キャンペーンが動いているプラットフォームであり、期間設定を雑に行うと「施策の効果」と「外部イベントの効果」が不可分に混ざってしまい、Before/After比較そのものが無意味になります。

具体的には、以下の3つが期間内に入り込んでいないかを必ずチェックしてください。

- プライムデー・ブラックフライデー・サイバーマンデー・初売りなどの大型セールイベントを避ける:Before/After期間は、これらの大型イベントを跨がない・含まないことを原則とします。どうしても跨がざるを得ない場合は、その期間を計算から除外するか、前年の同じセール期間同士を比較するなど、別軸の揃え方を検討します。

- 自社の広告・プロモーションの大幅な予算変動タイミングと重ならないようにする:検証したい施策とは別に、スポンサー広告の予算を倍増させた、クーポンを同時に発行した、といった他施策がBefore/After期間内で動いていると、どの打ち手が効いたのかを切り分けられなくなります。「検証したい1施策以外の変数を動かさないクリーンな期間」を意図的に確保することが重要です。

- 在庫切れ・サスペンド・カート落ちなどの異常期間を避ける:売上がゼロ/著しく低い日を含めると、成長率の計算が崩れます。販売状態が安定している期間を選びます。

注意すべきは、「どの期間がクリーンか」は案件ごと・施策ごとに異なるという点です。あるブランドにとっては8月が最も穏やかな期間でも、別のブランドでは夏のセールが主戦場かもしれません。「Before28日/After28日」のような一律のルールを機械的に適用するのではなく、案件ごと・施策ごとにカレンダーを見ながら個別判断することが、Before/After検証の精度を左右します。期間選定こそが検証の成否を決める工程と言っても過言ではありません。

ステップ3:KPI設計

施策カテゴリーごとに、売上成長率に加えて観察すべきKPIを設定します。以下は典型的な組み合わせ例です。

| 施策カテゴリー | 主要KPI | 観察の意図 |

|---|---|---|

| メイン画像・サブ画像変更 | 注文率(CVR)、ページビュー | クリック後の購買転換が改善したか |

| A+コンテンツ更新 | 注文率、カート獲得率 | 詳細情報の補強で納得感が上がったか |

| 価格変更・クーポン | 平均売価、注文率 | 値下げ幅に対する需要増がペイするか |

| スポンサー広告追加 | ROAS、CVR、広告経由売上、自然売上 | 広告効率と自然売上へのハロー効果 |

| DSP・OTT広告 | 新規顧客数、獲得単価、ページビュー | 認知拡大が新規獲得につながったか |

ステップ4:施策実行と記録

施策を実行する段階で重要なのは、「いつ」「何を」「どのASINに」「どんなメモ付きで」実施したかを必ず記録に残すことです。Excelで管理するケースが多いですが、担当者の離任や引き継ぎで失われやすいため、ツール化しておくことをおすすめします。

ステップ5:検証レポートの作成

After期間が終了したら、Before/Afterで売上成長率とKPI成長率を算出し、レポートとしてまとめます。レポート作成時に意識すべきは以下の3点です。

- 同カテゴリ・競合ASINとの比較:自社ASINだけでなく、カテゴリ全体のトレンドと比較することで、外部要因を除いた純粋な施策効果を推定できる

- 広告レポート・ビジネスレポートを突き合わせた深掘り:売上変化が広告経由によるものか、自然流入の改善によるものかを切り分けることで、次の打ち手の精度が上がる

- 成功・失敗の両方を記録する:失敗施策の記録は、次に「やらない判断」を支える貴重な資産になる

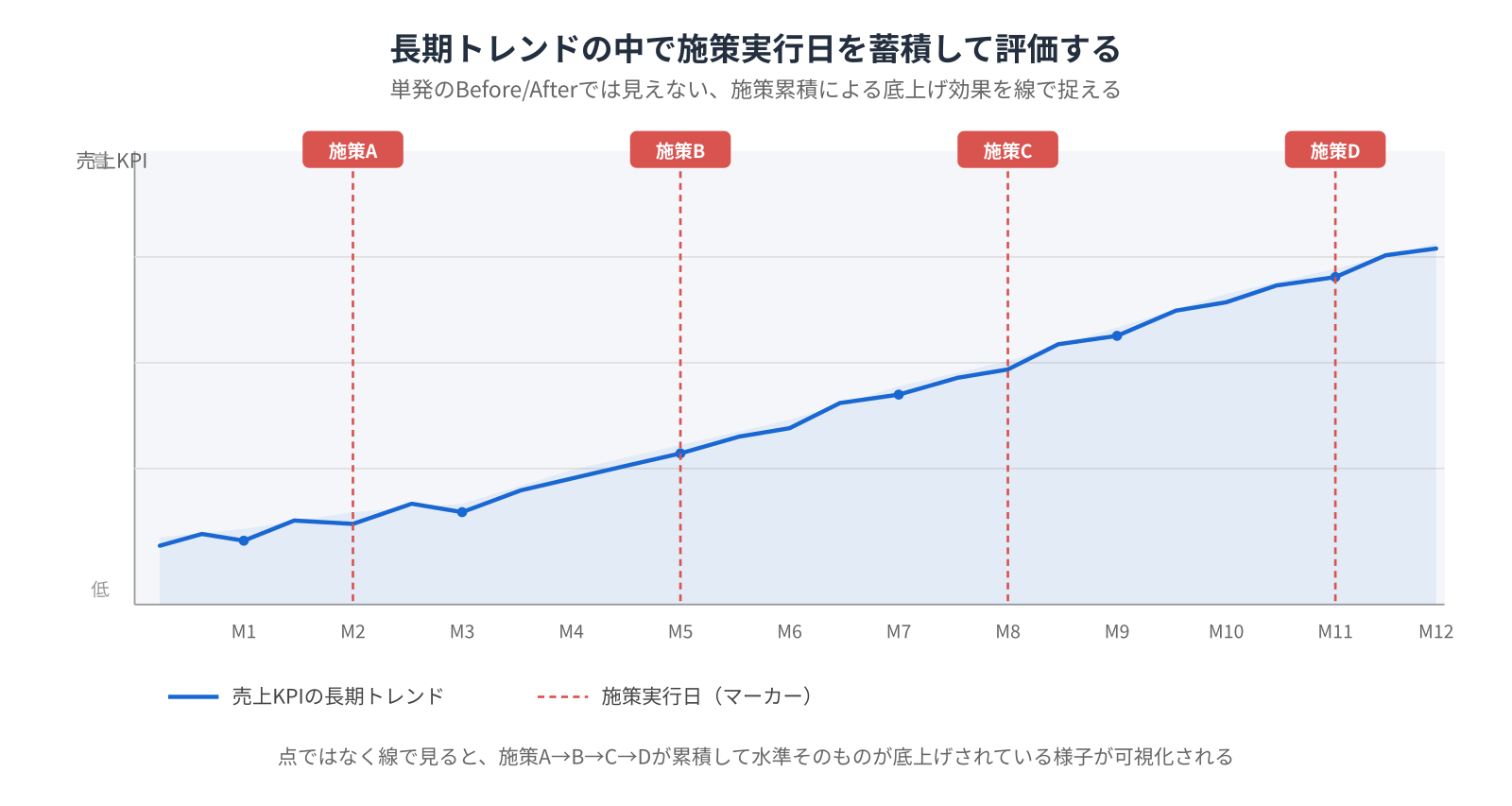

単発のBefore/Afterだけでは足りない――長期トレンドで評価する視点

ここまで5ステップでBefore/After検証を固めてきましたが、実はこれだけではまだ不十分です。Amazonというプラットフォームは、セール・競合の価格変更・カテゴリ全体の需要変動・アルゴリズム変更などにより、KPIのボラティリティ(変動幅)が非常に高いという特性を持っています。そのため、Before28日/After28日のような単発のBefore/After比較だけに頼ると、ノイズを施策効果と誤認してしまうリスクが常に残ります。

単発比較のリスク:ノイズを効果と誤判定する

例えば、施策Aを打った直後にROASが20%改善したとします。Before/After比較上は「施策Aが効いた」と結論付けたくなりますが、実はその裏で競合が在庫切れを起こしていた、Amazon側のおすすめ枠で露出が増えていた、カテゴリ全体の季節需要が立ち上がっていた、といった外的要因が重なっていた可能性は少なくありません。逆に、本当は効いていた施策が、たまたまその期間に競合セールが重なったせいで「効かなかった」と判定されてしまうこともあります。

つまり、単発のBefore/Afterは「その瞬間の切り取り」にすぎないということを認識しておく必要があります。

解決策:施策実行日を蓄積し、長期トレンドの中で評価する

この問題を解決する最も有効な方法は、施策レポートを1回きりで終わらせず、施策実行日の情報を継続的に蓄積していくことです。個々の施策のBefore/After結果を点として持つだけでなく、「いつ、どんな施策を打ったか」というタイムラインを長期トレンドの上に重ね合わせることで、以下のような見え方が可能になります。

- 施策の実行タイミングとKPIトレンドの変化点を重ねる:直近半年〜1年のROASや注文率のトレンドラインを描き、その上に施策実行日のマーカーを並べることで、「どの施策を打った時点からトレンドが明確に変化したか」を時系列で俯瞰できる

- ノイズと本質的な変化を区別できる:単発のスパイクか、それとも施策を起点に水準そのものがシフトしたのかを判定できる

- 似た施策同士の再現性が見える:過去に同種の施策を複数回打っていれば、その平均的な効果・標準偏差が見えてきて、次回の仮説精度が高まる

- 失敗施策の「隠れた効果」も検出できる:単発では効果なしと判定された施策が、長期トレンドでは緩やかに効いていたというケースも拾える

言い換えると、施策検証は「点」で見るのではなく「線」で見ることが重要です。Before/Afterのスナップショットと、長期トレンド上での施策日のマーキング――この2軸を併用することで、ようやくボラティリティの高いAmazon KPIの中から施策の純粋効果を取り出せます。

Ubun BASEの「施策レポート」機能でBefore/Afterを自動化する

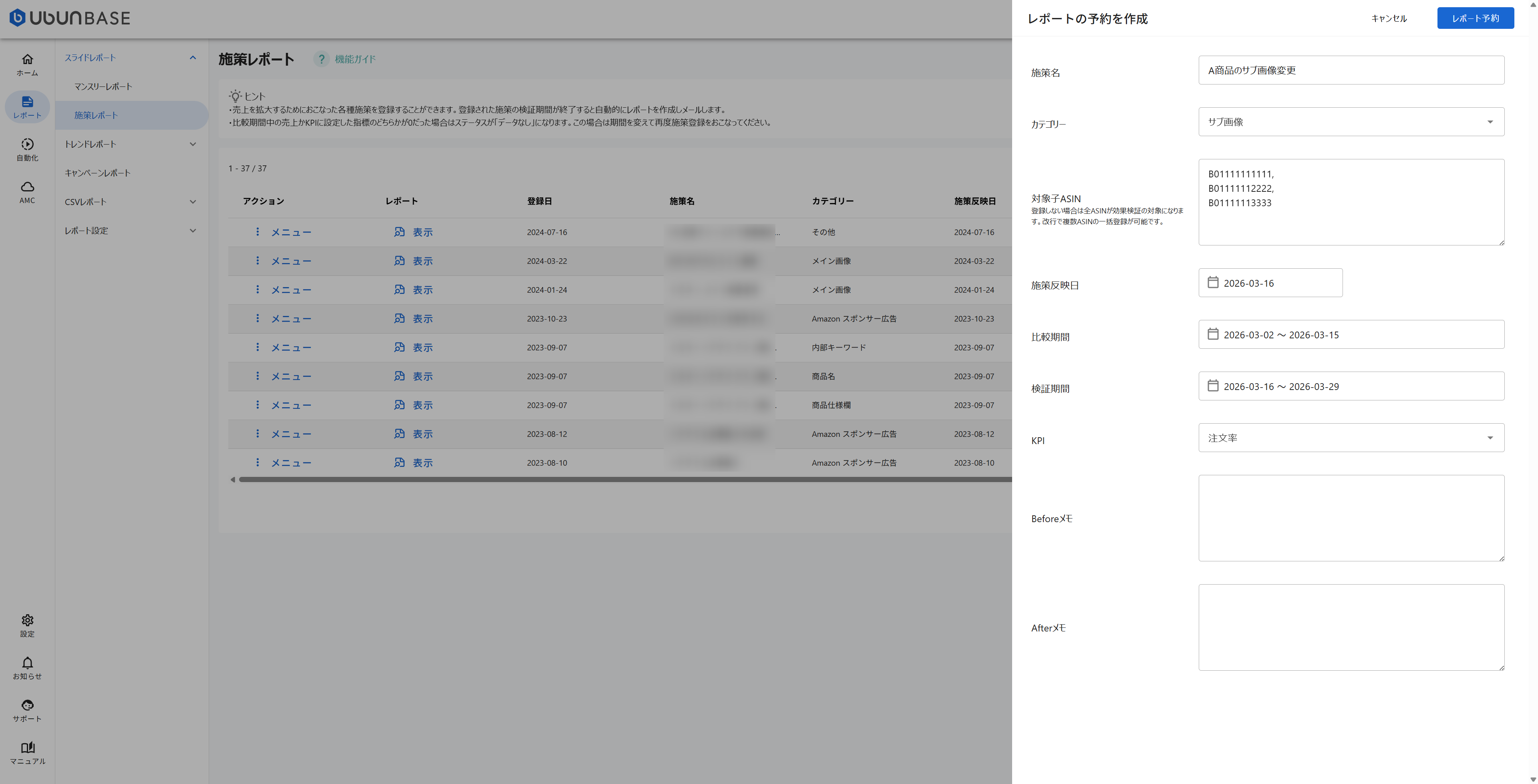

ここまで整理した5ステップのBefore/After検証フローは、正しく回せば大きな成果を生みますが、毎回の期間切り出し・KPI集計・レポート作成を手作業で行うと膨大な工数がかかります。この業務を丸ごと自動化するのが、Ubun BASEの「施策レポート」機能です。比較テストの管理では検証できない領域――広告追加、クーポン、価格変更、DSP、外部誘導など――を体系立ててBefore/After検証するための専用機能と位置づけられます。

施策レポート機能でできること

Ubun BASEのAnalyticsメニュー内にある「施策レポート」は、施策の登録から検証レポート自動生成までを一気通貫でサポートします。主な機能は以下のとおりです。

- 施策の事前登録:施策名・カテゴリー・対象ASIN・施策反映日・比較期間(Before)・検証期間(After)・KPI・Beforeメモを事前に登録

- 自動レポート生成:検証期間が終了すると、Ubun BASEのバッチが自動で売上成長率とKPI成長率を算出し、スライドレポートを自動生成

- メール通知:レポート生成が完了すると、登録者およびアカウントに紐づく全ユーザーへURL付きのメールが送信される

- 施策履歴の一元管理:実施した施策がすべて一覧画面に蓄積され、過去の成長率・レポートをいつでも参照可能

これにより、担当者は「施策を登録する」という1アクションだけで、後日自動的に検証レポートが手元に届く状態を作れます。

登録できる施策カテゴリーとKPI

施策レポート機能は、比較テストの管理でカバーされない広告・販促・価格系施策を含め、Amazon出品者が実施するほぼすべての施策タイプに対応します。

| 区分 | 選択可能項目 |

|---|---|

| カテゴリー(施策タイプ) | 商品名/メイン画像/サブ画像/A+/ブランドストーリー/商品仕様欄/商品説明文/内部キーワード/クーポン/プロモーション/セール/価格変更/VINE/レビューリクエスト/ストア/Amazonスポンサー広告/Amazon DSP/外部誘導(広告)/外部誘導(インフルエンサー)/その他 |

| KPI(検証指標) | ページビュー/注文率/平均売価/自然売上/広告経由売上/ROAS/CPC/CVR/CV単価/カート獲得率 |

対象ASINを空欄にすれば全ASINを対象に、改行区切りで複数ASINを入力すれば特定商品群のみを対象に検証できます。

比較テストの管理と施策レポートの使い分け

両者は競合ではなく、明確な役割分担の関係にあります。比較テストの管理は商品ページ要素の純粋比較で無類の強さを発揮し、施策レポートはそれ以外の広範な施策を時系列で体系評価する――この組み合わせで、Amazon運用の全施策領域がカバーされます。実務では以下のように使い分けるのがおすすめです。

| 観点 | 比較テストの管理(Manage Your Experiments) | Ubun BASE 施策レポート |

|---|---|---|

| 検証方式 | ABテスト(同時出し分け・統計的有意性を自動判定) | Before/After比較(時系列評価・長期トレンド蓄積) |

| 得意領域 | 商品ページ要素(画像・A+・タイトル等)の磨き込み | 広告・クーポン・価格・外部誘導など20種類の広範な施策 |

| 利用条件 | ブランド登録済み/販売実績あり | Ubun BASE契約のみ |

| 期間 | 4〜10週間の連続運用(統計的パワー確保のため) | 任意(例:前後28日ずつ) |

| 同時進行 | 同一ASINで1テスト(論点の優先順位設計が鍵) | 何本でも並行登録可能 |

| レポート | 比較テストの管理画面で統計判定+ワンクリック本番反映 | スライドレポートを自動生成・メール通知 |

販売規模が十分な主力ASINの商品ページ磨き込みは比較テストの管理をフル活用し、その対象外となる広範な施策はUbun BASEの施策レポートで体系評価する――この役割分担が、実務的にもっとも合理的で、かつ検証範囲を最大化する組み合わせです。

ワークフローはこう変わる

従来の手動Before/After検証と、施策レポート機能を使った自動検証を比較すると、以下のような違いが生まれます。

| ステップ | 手動検証 | 施策レポート機能 |

|---|---|---|

| 施策の記録 | Excelで手管理(属人化リスク) | 登録画面で構造化データとして保存 |

| データ集計 | レポートDL→期間抽出→関数計算 | 検証期間終了後にバッチが自動集計 |

| レポート作成 | PowerPoint等で毎回作成 | スライドレポートが自動生成 |

| 共有 | ファイル添付・URL共有 | アカウント内の全ユーザーへ自動メール |

| 履歴管理 | フォルダ・ファイル名依存 | 一覧画面で売上成長率順に参照可能 |

広告レポート・ビジネスレポートを横断したダッシュボード連携

Ubun BASEは施策レポート機能に加えて、Amazon広告の自動入札・広告レポート、売上・利益のビジネスレポート/利益レポートも同一プラットフォーム上で提供しています。例えば「スポンサー広告追加」の施策を検証する際に、施策レポートで売上成長率・ROAS変化を確認しつつ、広告レポートでキーワード別・ターゲティング別の貢献を、ビジネスレポートで自然売上とのバランスまで一気に確認する、という使い方が可能です。これにより、単なるBefore/Afterの比較を超えた、多角的な施策検証を実現できます。

まとめ

Amazonでの施策検証は、単なる効果測定ではなく、組織としての学習メカニズムです。正しく回すために押さえるべきポイントは以下のとおりです。

- Amazon公式のABテスト機能「比較テストの管理(Manage Your Experiments)」は、ランダム出し分け・統計処理・有意性判定までAmazonが自動で行う極めて優秀な無料ツール。商品ページ要素の磨き込みにおいては、ブランド登録済み出品者にとって事実上の標準装備と言える強力な武器

- 一方で対象範囲は商品ページ要素に限定されるという設計思想上のトレードオフがあり、広告・クーポン・価格・外部誘導などそれ以外の広範な施策はBefore/After比較で体系評価するのが現実的な補完アプローチ

- 比較テストの管理とBefore/Afterは敵対関係ではなく役割分担。使える領域では比較テストの管理を全力で使い、対象外の領域をBefore/Afterで埋めることで、Amazon運用の全施策領域が初めて検証可能になる

- Before/Afterのつまずきポイントは、期間の曖昧さ・外部要因・ハロー効果・KPI未定義・データ横断の手間の5つ

- 検証の基本フレームは「事前設計→期間固定→KPI設計→実行→レポート」の5ステップ。とくに期間設定はセール・大型広告変動を避け、案件ごとに個別判断することが肝心

- 単発のBefore/Afterでは誤判定しやすいため、施策実行日を長期トレンド上に蓄積し、線で評価する視点が不可欠

- Ubun BASEの「施策レポート」機能は、施策登録→自動集計→スライドレポート自動生成→メール通知までをワンストップで提供し、長期の施策履歴蓄積によって検証の質を年々高められる

施策を打ちっぱなしにせず、1つひとつの結果を資産として積み上げていくことが、Amazonでの長期的な成長を実現する鍵となります。比較テストの管理が使える領域では全力でこの強力な武器を使いこなし、その対象外の領域はUbun BASEの施策レポート機能で自動化する――この役割分担で、Before/After検証の自動化と長期トレンドでの評価に挑戦してみてはいかがでしょうか?

株式会社ウブン PdM of UbunBASE

2007年に株式会社オプトに入社し、金融業界向けインターネット広告の提案・運用を担当。株式会社電通に出向し、大手ナショナルクライアントのデジタルメディア戦略の立案と実行に従事。2012年にオプトに帰任後、DSPや広告効果測定ツールのプロダクトマネージャーを歴任。グループ会社のスキルアップビデオテクノロジーズでは取締役として動画広告のアドテクノロジー事業を推進。2020年に株式会社ウブンに参画し、Amazonレポートの自動化ツール「Ubun BASE」を立ち上げ、開発とマーケティングを統括。